你有没有想过:为什么现在满世界都是"Python 包装 API"的工具?你打开 GitHub,搜索 python + api + wrapper,瞬间弹出几百个项目。有的包装 OpenAI,有的包装 Claude,有的包装 Google NotebookLM,还有的更狠——直接,把 ChatGPT 免费网页端,变成 OpenAI 兼容 API。这玩意儿凭啥这么火?

作为一个写了几年代码的老炮,今天给你扒一扒这个赛道背后的逻辑。

01. 一个故事

事情是这样的。

我有个朋友,做了一个 AI 聊天应用。刚开始用的是 OpenAI API,调用量大了之后,成本直接起飞。

然后他发现了PhantomAPI这个开源项目——它能把 ChatGPT 免费网页端变成 API,零成本调用 GPT-4。

他激动坏了,马上部署,本地跑起来,美滋滋。

结果三天后,账号被封了。

但你知道他说什么吗?"哪怕被封三个月,我也值了。"

这就是这个赛道的现状:需求太刚性,刚性到让人愿意冒风险。

02. 火的本质:生态碎片化

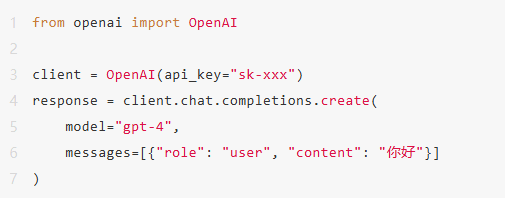

你可能用过 OpenAI 的 SDK,调用很简单:

但是,当你需要同时调用 Claude、Gemini、DeepSeek、MoE 的时候,问题来了:

-

每家 API 端点不同

-

认证方式不同

-

返回格式不同

-

超时处理不同

你能想象同时维护 5 个客户端的痛苦吗?

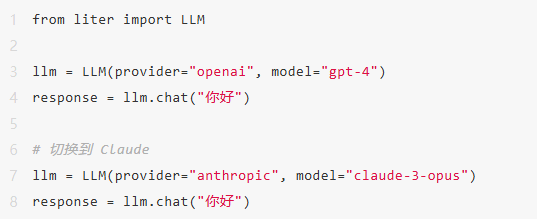

这就是为什么 liter-llm 这种项目能火——它支持 142 个 LLM 提供商,一个接口通吃:

一句话总结:不是开发者闲得蛋疼要造轮子,而是生态太碎片,不造轮子没法活。

03. 另一个刚需:白嫖与套利

如果说上面是"正常需求",那下面这个就有点灰色了。

PhantomAPI —— 把 ChatGPT 免费网页端封装成 OpenAI 兼容 API。

零成本、零 API 密钥调用 GPT-4。

虽然账号风险高,但很多人就是敢用。为什么?

-

个人实验无所谓

-

小项目能省一点是一点

-

甚至有人做"API 二道贩子",中间赚差价

这不是鼓励大家去白嫖,而是说:当官方 API 定价让普通人用不起时,野生方案就会层出不穷。

04. 还有一类:生态桥梁

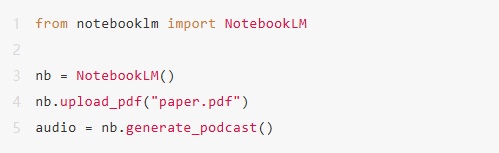

notebooklm-py(1.2 万星)就是典型代表。

Google NotebookLM 是个很强的工具,能把 PDF 变成播客、生成摘要。但官方没有 API。

然后有人逆向工程,写了个 Python SDK:

这就是典型的"生态桥梁"——官方不提供的,我来提供。

类似的还有:

-

kiro-gateway:把 Amazon Q 变成 OpenAI 兼容 API

-

MacOSLocalAPI:把 MacOS 本地 AI 变成 OpenAI 风格 API

-

mcp-client:把 MCP 协议转成 OpenAI API

本质都是:哪里有缺口,哪里就有包装。

05. 我的独家洞察

很多人觉得这些包装工具技术含量低,不就是调个 HTTP 请求吗?

错了。

真正的难点不在于"调用 API",而在于:

-

协议转换 - 把不同家的 API 格式统一成一种

-

错误处理 - 每家超时、限流、返回错误的处理方式都不同

-

维护成本 - 官方 API 改个参数,你可能得连夜改代码

-

边界场景 - 流式输出、函数调用、多模态...每个坑都得踩一遍

这本质上是个"苦力活",但也是真正的价值所在。

就好比,全世界都在造汽车,但有人专门做"汽车适配不同国家油品"的生意——看似简单,不可或缺。

06. 未来会怎样?

我的判断:

-

官方会开始封锁 - PhantomAPI 这种灰色地带生存空间会越来越小

-

标准化是趋势 - Anthropic 推出的 ACP(Agent Client Protocol)可能就是未来

-

中间层会收敛 - 最终可能就 2-3 个大一统框架存活

07. 结尾

所以,Python 包装第三方 AI API 这事儿,看起来简单,其实水深得很。

它火,不是因为技术有多牛,而是因为它解决了真实的痛点——生态碎片化。

而但凡能解决真实痛点的东西,想不火都难。

以上就是“Python 包装第三方 AI API,是怎么火起来的?”的详细内容,想要了解更多Python教程欢迎持续关注编程学习网。

扫码二维码 获取免费视频学习资料

- 本文固定链接: http://www.phpxs.com/post/14136/

- 转载请注明:转载必须在正文中标注并保留原文链接

- 扫码: 扫上方二维码获取免费视频资料